软件

产品

tf.nn.relu()函数是将大于0的数保持不变,小于0的数置为0

a = tf.constant([-1.0, 2.0])

with tf.Session() as sess:

b = tf.nn.relu(a)

print (sess.run(b))

输出

再举个例子吧:

import tensorflow as tf

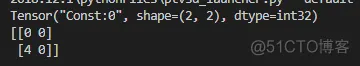

a = tf.constant([[-2,-4],[4,-2]])

with tf.Session() as sess:

print(sess.run(tf.nn.relu(a)))

输出:

免责声明:本文系网络转载或改编,未找到原创作者,版权归原作者所有。如涉及版权,请联系删

武汉格发信息技术有限公司,格发许可优化管理系统可以帮你评估贵公司软件许可的真实需求,再低成本合规性管理软件许可,帮助贵司提高软件投资回报率,为软件采购、使用提供科学决策依据。支持的软件有: CAD,CAE,PDM,PLM,Catia,Ugnx, AutoCAD, Pro/E, Solidworks 等。